LLM Latency Optimization hiện là một ưu tiên hàng đầu của các doanh nghiệp đang triển khai AI trong môi trường production. Dù là chatbot AI, trợ lý giọng nói hay hệ thống ra quyết định theo thời gian thực, phản hồi chậm đều ảnh hưởng trực tiếp đến trải nghiệm người dùng, tỷ lệ chuyển đổi và hiệu quả vận hành.

Tại các thị trường như Úc, Singapore, Mỹ và châu Âu, người dùng kỳ vọng phản hồi gần như tức thì. Chỉ cần chậm vài giây, hệ thống AI có thể khiến người dùng rời đi, giảm mức độ tương tác và làm suy giảm niềm tin vào sản phẩm.

Đó là lý do vì sao LLM Latency Optimization không chỉ là một vấn đề kỹ thuật, mà còn là một chiến lược kinh doanh.

Tại NKKTech Global, các kỹ sư AI thiết kế những hệ thống có khả năng mở rộng, trong đó LLM Latency Optimization đóng vai trò quan trọng để đảm bảo hiệu suất theo thời gian thực cho các ứng dụng doanh nghiệp, từ tự động hóa chăm sóc khách hàng đến AI call center.

Vì sao độ trễ quan trọng trong hệ thống AI doanh nghiệp

Độ trễ quyết định một hệ thống AI phản hồi nhanh đến mức nào sau khi nhận yêu cầu. Trong các ứng dụng real-time như voice AI hoặc chatbot hỗ trợ khách hàng, độ trễ liên quan trực tiếp đến mức độ hài lòng của người dùng.

Nếu chatbot phản hồi quá chậm, người dùng sẽ mất kiên nhẫn. Với hệ thống giọng nói, độ trễ làm gián đoạn dòng hội thoại tự nhiên.

Đây chính là lúc LLM Latency Optimization trở nên cần thiết.

Doanh nghiệp đầu tư vào việc giảm độ trễ có thể:

- Cải thiện trải nghiệm khách hàng

- Tăng tỷ lệ chuyển đổi

- Giảm tỷ lệ bỏ cuộc giữa chừng

- Hỗ trợ tự động hóa theo thời gian thực

Ngược lại, độ trễ cao tạo ra ma sát, làm giảm hiệu quả và làm tăng chi phí vận hành.

Độ trễ đến từ đâu

Trước khi áp dụng giải pháp, doanh nghiệp cần hiểu rõ nguồn gốc gây chậm.

Các nguyên nhân phổ biến gồm:

- Mô hình quá lớn, yêu cầu tính toán nặng

- Độ trễ mạng giữa các hệ thống

- Prompt chưa tối ưu

- API call thiếu hiệu quả

- Không có cơ chế cache phù hợp

Mỗi yếu tố này đều góp phần làm tăng thời gian phản hồi, khiến LLM Latency Optimization trở thành một bài toán nhiều lớp.

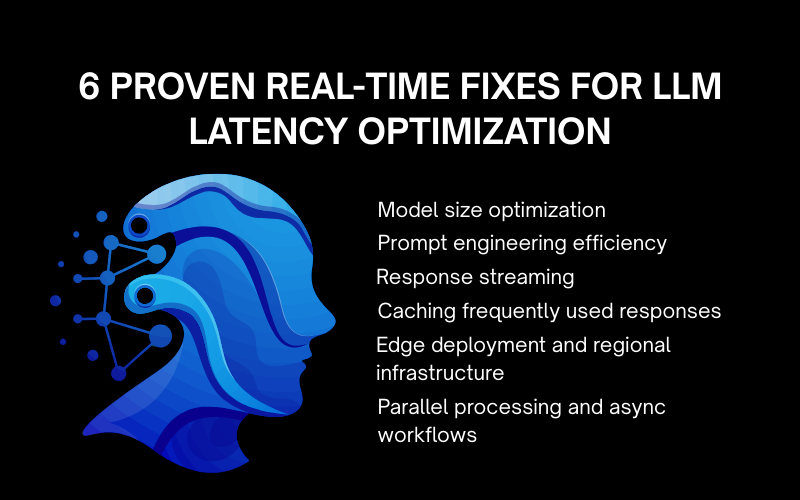

6 cách tối ưu độ trễ LLM đã được chứng minh

Dưới đây là 6 kỹ thuật thực tế mà các đội ngũ AI doanh nghiệp đang dùng để giảm độ trễ và cải thiện hiệu suất thời gian thực.

1. Tối ưu kích thước mô hình

Mô hình càng lớn thường cho câu trả lời tốt hơn, nhưng cũng mất nhiều thời gian xử lý hơn.

Một trong những chiến lược LLM Latency Optimization hiệu quả nhất là chọn đúng kích thước mô hình cho từng use case.

Không phải ứng dụng nào cũng cần mô hình lớn nhất.

Ví dụ:

- FAQ khách hàng → dùng mô hình nhỏ, phản hồi nhanh

- Bài toán suy luận phức tạp → dùng mô hình lớn hơn

Chọn đúng mô hình sẽ giúp giảm thời gian phản hồi mà vẫn giữ chất lượng đủ tốt.

2. Tối ưu prompt engineering

Thiết kế prompt ảnh hưởng trực tiếp đến độ trễ.

Prompt dài và phức tạp sẽ làm tăng thời gian xử lý và số lượng token.

Vì vậy, tối ưu prompt là một phần quan trọng của LLM Latency Optimization.

Best practices

- Giữ prompt ngắn gọn

- Loại bỏ hướng dẫn không cần thiết

- Cấu trúc đầu vào rõ ràng

Prompt hiệu quả giúp suy luận nhanh hơn và giảm chi phí.

3. Streaming phản hồi

Thay vì chờ toàn bộ câu trả lời hoàn tất rồi mới trả về, streaming cho phép hệ thống gửi phản hồi ngay khi mô hình bắt đầu sinh token.

Kỹ thuật này giúp cải thiện mạnh cảm nhận về tốc độ.

Đối với voice AI và chatbot, streaming là một trong những phương pháp LLM Latency Optimization có tác động rõ nhất.

Người dùng cảm thấy tương tác nhanh hơn, ngay cả khi tổng thời gian xử lý thực tế không giảm quá nhiều.

4. Cache các phản hồi thường gặp

Nhiều ứng dụng AI phải xử lý những câu hỏi lặp đi lặp lại.

Cơ chế cache cho phép hệ thống lưu lại và tái sử dụng phản hồi cho các yêu cầu phổ biến, thay vì gọi lại mô hình nhiều lần.

Đây là một kỹ thuật LLM Latency Optimization đơn giản nhưng rất hiệu quả, đặc biệt trong môi trường chăm sóc khách hàng.

5. Edge deployment và hạ tầng theo khu vực

Độ trễ chịu ảnh hưởng lớn bởi khoảng cách vật lý giữa người dùng và máy chủ.

Triển khai hệ thống AI gần hơn với người dùng giúp giảm đáng kể network latency.

Đối với doanh nghiệp phục vụ thị trường Úc hoặc Singapore, hạ tầng theo khu vực là rất quan trọng.

Đây là một phần cốt lõi của LLM Latency Optimization trong các ứng dụng toàn cầu.

Sử dụng edge computing hoặc triển khai cloud theo khu vực giúp thời gian phản hồi nhanh hơn đáng kể.

6. Xử lý song song và async workflow

Thay vì xử lý tuần tự, doanh nghiệp có thể chạy nhiều tác vụ song song.

Ví dụ:

- Lấy dữ liệu khách hàng

- Chạy intent detection

- Chuẩn bị câu trả lời

Tất cả có thể diễn ra cùng lúc.

Thực thi song song giúp giảm mạnh tổng thời gian phản hồi và là một chiến lược LLM Latency Optimization rất quan trọng trong hệ thống doanh nghiệp.

Tác động thực tế của LLM Latency Optimization

Các công ty triển khai thành công LLM Latency Optimization thường thấy những cải thiện rõ ràng như:

- Tương tác với khách hàng nhanh hơn

- Tỷ lệ engagement cao hơn

- Mức độ chấp nhận AI trong nội bộ tốt hơn

- Chi phí hạ tầng thấp hơn

Trong AI call center, giảm độ trễ giúp hội thoại tự nhiên hơn. Với chatbot, nó giúp tăng thời lượng phiên và tỷ lệ chuyển đổi.

Với doanh nghiệp toàn cầu, LLM Latency Optimization không còn là lựa chọn — mà là lợi thế cạnh tranh.

LLM Latency Optimization trong hệ thống voice AI

Độ trễ còn quan trọng hơn trong ứng dụng giọng nói.

Khác với hệ thống text, hội thoại bằng giọng nói đòi hỏi phản hồi gần như tức thì để giữ cảm giác tự nhiên.

Chỉ cần chậm hơn 1–2 giây, trải nghiệm đã có thể bị phá vỡ.

Điều này khiến LLM Latency Optimization trở nên thiết yếu cho:

- AI call center

- Trợ lý giọng nói

- Hệ thống đặt lịch tự động

Tại NKKTech Global, các hệ thống voice AI được thiết kế với pipeline độ trễ thấp, kết nối liền mạch giữa nhận dạng giọng nói, language model và sinh phản hồi.

Xây dựng hệ thống AI độ trễ thấp có thể mở rộng

Muốn LLM Latency Optimization hiệu quả, doanh nghiệp cần thiết kế hệ thống theo hướng tổng thể.

Các thành phần quan trọng gồm:

- Chọn mô hình được tối ưu tốt

- Kiến trúc API hiệu quả

- Pipeline xử lý dữ liệu theo thời gian thực

- Lớp cache thông minh

- Hạ tầng cloud có thể mở rộng

Tất cả phải phối hợp với nhau để tạo ra hiệu năng ổn định ở nhiều thị trường khác nhau.

Với doanh nghiệp hoạt động ở nhiều khu vực, việc giữ độ trễ thấp đồng đều cho tất cả người dùng là một thách thức rất lớn.

Xu hướng tương lai của LLM Latency Optimization

Khi công nghệ AI tiếp tục phát triển, nhiều hướng tiếp cận mới cho LLM Latency Optimization đang xuất hiện.

Một số xu hướng nổi bật gồm:

- Kiến trúc mô hình nhỏ hơn nhưng hiệu quả hơn

- Xử lý AI ngay trên thiết bị

- Tăng tốc bằng phần cứng chuyên dụng

- Kỹ thuật nén mô hình tốt hơn

Những đổi mới này sẽ giúp doanh nghiệp cung cấp trải nghiệm AI nhanh hơn với chi phí thấp hơn.

Kết luận

Hệ thống AI chỉ thật sự hiệu quả khi nó có thể phản hồi theo thời gian thực.

Phản hồi chậm làm giảm mức độ tương tác, tăng cảm giác khó chịu và giới hạn giá trị của tự động hóa.

Bằng cách áp dụng những kỹ thuật đã được chứng minh như tối ưu mô hình, cache, streaming và edge deployment, doanh nghiệp có thể cải thiện hiệu năng một cách đáng kể.

Hiểu rõ LLM Latency Optimization giúp doanh nghiệp xây dựng các hệ thống AI không chỉ thông minh mà còn nhanh và đáng tin cậy.

Xây dựng hệ thống AI độ trễ thấp cùng NKKTech Global

Tại NKKTech Global, chúng tôi chuyên thiết kế các hệ thống AI hiệu năng cao cho môi trường doanh nghiệp.

Đội ngũ kỹ sư của chúng tôi triển khai các chiến lược LLM Latency Optimization nâng cao để đảm bảo phản hồi theo thời gian thực cho:

- AI chatbot

- Nền tảng voice AI

- AI call center

- Hệ thống tự động hóa doanh nghiệp

Nếu doanh nghiệp của bạn đang muốn cải thiện hiệu năng AI và giảm thời gian phản hồi, NKKTech Global có thể hỗ trợ xây dựng giải pháp độ trễ thấp, có khả năng mở rộng.

Liên hệ NKKTech Global ngay hôm nay để bắt đầu tối ưu hệ thống AI cho hiệu suất thời gian thực.

Thông tin liên hệ:

🌎 Website: https://nkk.com.vn

📩 Email: contact@nkk.com.vn

💼 LinkedIn: https://www.linkedin.com/company/nkktech