AIは急速に進化し、企業システムの中心に入りつつあります。しかし、従来のモノリシック構造のままAIを拡張しようとすると、システムの複雑化や運用負荷の増大、コストの急激な増加を招く可能性があります。

そこで注目されているのが Microservices アーキテクチャ です。

AIシステムを小さく独立したサービスに分割することで、拡張性・可用性・運用効率を大幅に改善できます。

現在、多くのエンタープライズAIプラットフォームは Microservices ベースの設計 を採用しています。これにより、モデルの更新、リアルタイム推論、データ処理パイプラインを柔軟に管理できるようになります。

本記事では、スケーラブルなAIシステムを構築するための 5つの Microservices 設計パターン を紹介します。

なぜAIシステムに Microservices が必要なのか

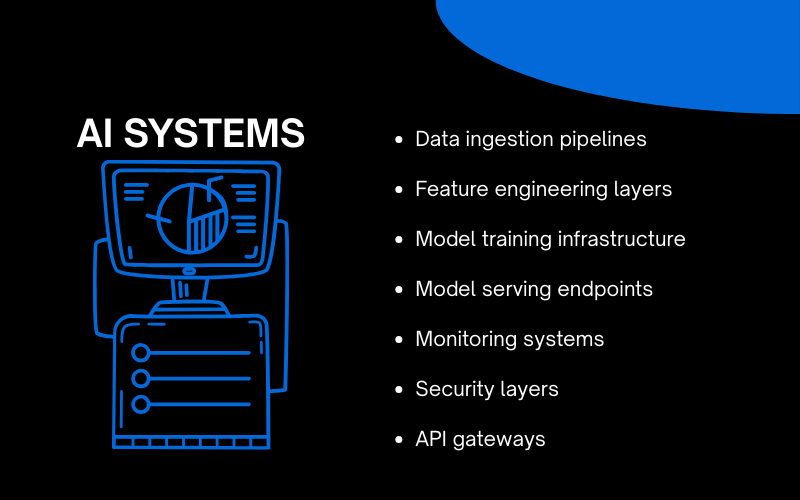

AIシステムは、通常のアプリケーションよりも多くのコンポーネントを含みます。

例えば:

- データ収集パイプライン

- 特徴量生成(Feature Engineering)

- モデル学習インフラ

- モデル推論API

- モニタリングシステム

- セキュリティ管理

- APIゲートウェイ

これらすべてを1つのシステムにまとめると、運用は非常に複雑になります。

そこで Microservices アーキテクチャ を導入すると、各コンポーネントを独立したサービスとして管理できます。

主なメリット:

- 独立したデプロイ

- 高速なアップデート

- 障害の影響範囲を限定

- 柔軟なスケーリング

- セキュリティの分離

- コンプライアンス管理の容易化

これは単なるトレンドではなく、エンタープライズソフトウェアの標準設計となっています。

1. Microservices による Model-as-a-Service (MaaS)

AIシステムにおける最も一般的な Microservices パターン の1つが Model-as-a-Service です。

この設計では、各AIモデルを独立したサービスとして提供します。

構成例:

- 各モデルを個別の Microservices として実行

- REST または gRPC APIで公開

- Dockerコンテナ化

- Kubernetesで自動スケーリング

この方法により、バックエンドアプリケーションからモデルを切り離すことができます。

なぜスケーラブルなのか

AIモデルごとに必要なリソースは異なります。

例えば:

- NLPモデル → メモリ使用量が多い

- 画像認識モデル → GPUが必要

- レコメンドシステム → 低レイテンシ

Microservices により、各モデルを個別にスケールできます。

実際の利用例

ECプラットフォームでは、以下を別サービスとして分離できます。

- 不正検知モデル

- 商品レコメンド

- 顧客感情分析

2. Microservices データパイプライン 設計

AIの品質はデータ品質に依存します。

従来のETLパイプラインは1つの巨大な処理として実装されることが多いですが、

現在のAIプラットフォームでは Microservices による分散データ処理 が主流です。

典型的な構成:

- データ取り込みサービス

- データ検証サービス

- 特徴量生成サービス

- データ変換サービス

- ストレージサービス

各処理を Microservices として分離することで、柔軟な拡張が可能になります。

メリット

- 一部の処理が失敗しても全体が停止しない

- 新しいデータソースを追加しやすい

- パイプラインの変更が容易

金融システムでは、次のように分割できます:

- 取引データ正規化

- 不正検知タグ付け

- リスクスコア計算

- レポート生成

3. リアルタイムAIのための Microservices + Event Driven Architecture

リアルタイムAIには高速処理とスケーラビリティが求められます。

そのため、Microservices とイベント駆動アーキテクチャ の組み合わせが非常に効果的です。

構成例:

- ユーザー行動や取引データがイベントとして発生

- Kafka / RabbitMQ がイベントを配信

- 各AI Microservices がイベントを処理

この構造により、AIサービスはリアルタイムに反応できます。

適用例:

- リアルタイム不正検知

- IoT異常検知

- レコメンドシステム

- 動的価格設定

トラフィックが急増しても、対象の Microservices のみスケールすれば対応できます。

4. Microservices による Training と Inference の分離

多くの企業が犯す設計ミスの1つが、

モデル学習と推論を同じシステムで処理することです。

この2つは性質がまったく異なります。

Training

- GPU中心

- バッチ処理

- 高い計算負荷

Inference

- 低レイテンシ

- 高可用性

- リアルタイム処理

そのため、Microservices を使って完全に分離する設計 が推奨されます。

5. AI監視のための Microservices Observability

AIシステムでは、モデル精度の低下やデータドリフトが発生します。

そのため、AI監視機能も Microservices として独立させる 必要があります。

主な監視サービス:

- モデル精度モニタリング

- データドリフト検知

- 推論レイテンシ監視

- バイアス検知

- アラートシステム

この設計により、AIシステムの問題を早期に検知できます。

AIプラットフォームに必要な Microservices インフラ

AI Microservices を運用するためには、次のインフラが重要です。

コンテナ化

- Docker

- OCI container runtime

オーケストレーション

- Kubernetes

- Auto-scaling cluster

API管理

- API Gateway

- Access control

- Rate limiting

CI/CD

- 独立デプロイ

- Canary release

- 自動ロールバック

AI Microservices 設計でよくある失敗

Microservices は万能ではありません。

よくある失敗:

- サービス分割のしすぎ

- サービス間通信設計の不足

- ログ管理の欠如

- APIバージョン管理の不足

- サービス間セキュリティの弱さ

Microservices には設計ガバナンスが必要です。

まとめ

AIのスケーリングは「大きなモデル」だけでは実現できません。

重要なのは アーキテクチャ設計 です。

Microservices はAIシステムに次の価値を提供します。

- モジュール化

- 高可用性

- スケーラビリティ

- セキュリティ強化

- コスト最適化

AIを実験段階からエンタープライズ基盤へ進化させるためには、

Microservices アーキテクチャが不可欠です。

NKKTech Globalと構築するAI Microservices

NKKTech Globalでは、AIワークロード向けに最適化された

Microservices アーキテクチャ設計と実装 を提供しています。

私たちは企業のAIシステムを:

- モノリシック構造から Microservices に分解

- APIベースのモデル提供を実装

- Training / Inference 環境を分離

- リアルタイムAIプラットフォームを構築

- KubernetesベースのAIインフラを導入

- AI監視とコンプライアンス体制を整備

AIプラットフォームが急成長しているのにアーキテクチャが追いついていない場合、

今こそ基盤を見直すタイミングです。

NKKTech Global と共に、スケーラブルで安全な AI Microservices アーキテクチャを構築しましょう。

お問い合わせ先

Website: https://nkk.com.vn

Email: contact@nkk.com.vn

LinkedIn: https://www.linkedin.com/company/nkktech